L’essor de l’intelligence artificielle a fait émerger une nouvelle catégorie de systèmes particulièrement puissants : l’agent IA. Contrairement aux bots ou aux scripts automatisés qui se contentent de réagir à une requête, un agent IA est conçu pour percevoir son environnement, raisonner de manière autonome et agir afin d’atteindre un objectif précis. Il peut analyser des données, prendre des décisions, déclencher des actions et s’adapter aux changements sans intervention humaine constante.

On retrouve l’agent IA aussi bien dans les assistants conversationnels, en finance, dans l’industrie, que dans les systèmes autonomes comme les drones ou les robots humanoïds.

Dans cet article, nous allons expliquer ce qu’est un agent IA, comment il fonctionne, où et pourquoi il est utilisé, ainsi que les bénéfices qu’il peut apporter.

Nous aborderons également les aspects d’architecture technique, les enjeux éthiques et les bonnes pratiques de gouvernance nécessaires pour déployer ces systèmes.

Qu’est-ce qu’un agent IA ?

Un agent IA est un programme autonome qui peut observer son environnement, analyser ce qu’il perçoit et agir en conséquence. Pour cela, il suit une boucle continue : Percevoir → Décider → Agir.

Contrairement à un simple bot ou à un script automatisé, un agent IA ne se contente pas de répondre à des commandes. Il peut prendre des initiatives. Par exemple, il peut envoyer une alerte, proposer une action ou accomplir automatiquement une tâche lorsqu’il détecte une situation particulière.

Un agent IA dispose souvent d’une mémoire, qui lui permet de garder le contexte d’une situation ou de se rappeler des interactions passées. Il peut également intégrer des capacités d’apprentissage, ce qui signifie qu’il améliore ses décisions au fil du temps.

Il existe différents types d’agents :

- Réactifs : ils répondent directement aux situations.

- À modèle interne : ils se font une représentation du monde autour d’eux.

- Orientés objectifs : ils planifient des actions pour atteindre un but.

- Utilitaires : ils cherchent la meilleure option selon un critère (comme le gain ou le coût).

- Apprenants : ils évoluent grâce à l’expérience.

Dans la pratique, de nombreux agents IA modernes combinent plusieurs de ces approches.

Les agents IA dans les systèmes autonomes et multi‑agents

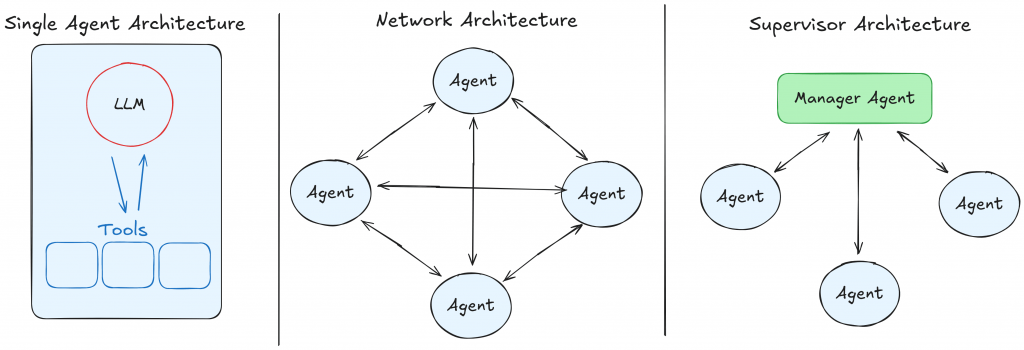

Dans certains cas, un agent IA agit seul pour accomplir une tâche précise. On parle alors d’un système autonome : l’agent prend ses décisions localement en fonction de ce qu’il perçoit, sans dépendre d’un contrôle central. C’est par exemple le cas d’un robot aspirateur qui analyse son environnement immédiat pour ajuster sa trajectoire.

Cependant, lorsqu’il s’agit de gérer des situations plus complexes ou de grande échelle, plusieurs agents IA peuvent être utilisés ensemble. On parle alors de systèmes multi‑agents. Dans ce type de système, chaque agent possède son propre point de vue et ses propres objectifs, mais l’intelligence globale émerge de leurs interactions. Les agents peuvent coopérer, se coordonner, voire négocier entre eux afin d’atteindre un résultat commun.

L’intérêt principal de ces systèmes est la scalabilité. Au lieu de confier toutes les décisions à un système central unique, on répartit le travail : chaque agent se spécialise dans une partie du problème. Cela rend l’ensemble plus flexible et plus robuste. Par exemple, si un agent tombe en panne, les autres peuvent continuer à fonctionner.

On retrouve ce fonctionnement dans plusieurs domaines :

- Des essaims de drones qui cartographient une zone ou interviennent sur une mission.

- Des systèmes de circulation intelligents capables d’adapter les feux tricolores en fonction du trafic.

- Des réseaux énergétiques (« smart grids ») où les agents équilibrent la consommation et la production.

Cas d’usage concrets en entreprise

Les agents IA sont aujourd’hui largement utilisés en entreprise, car ils permettent d’automatiser des tâches, d’accélérer la prise de décision et d’améliorer la qualité de service. Leur impact est particulièrement visible dans le support client. Par exemple, un agent conversationnel peut répondre aux demandes simples 24h/24 et 7j/7, ouvrir un ticket ou consulter l’état d’une commande. Cela permet de réduire les temps d’attente et de soulager les équipes, qui peuvent se concentrer sur les cas plus complexes.

Les agents IA jouent également un rôle dans la productivité au quotidien. Intégrés à des outils de travail (suite bureautique, messagerie, planification), ils peuvent rédiger des comptes rendus, résumer des documents, classer des e‑mails ou générer des propositions. De nombreuses entreprises constatent ainsi un gain d’heures par semaine pour chaque collaborateur.

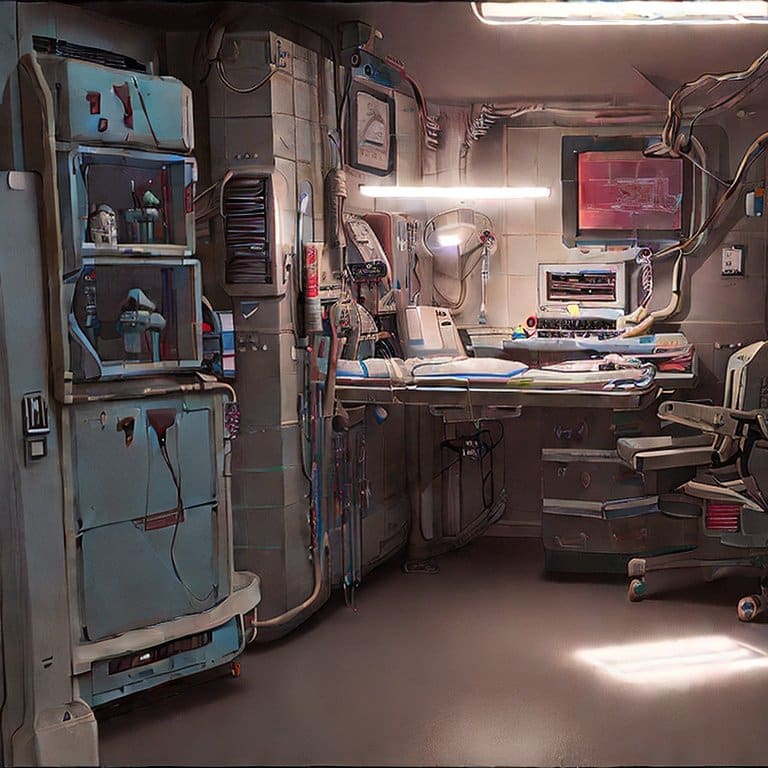

Dans l’industrie, les agents IA pilotent des robots mobiles dans les entrepôts, surveillent l’état des machines et déclenchent des actions de maintenance préventive. Cela réduit les arrêts imprévus et améliore la qualité de production.

En finance, certains agents analysent des flux de données en temps réel pour détecter des anomalies ou automatiser des décisions d’achat ou de vente. Dans la logistique, ils optimisent les itinéraires de livraison ou ajustent l’organisation des stocks.

Architecture technique d’un agent IA

Pour fonctionner de manière autonome, un agent IA s’appuie sur plusieurs briques techniques organisées en boucle continue : percevoir, raisonner, agir, puis apprendre.

Perception : capteurs et sources de données

L’agent commence par collecter des informations sur son environnement. Ces données peuvent provenir :

- de capteurs physiques (caméras, microphones, capteurs IoT, LIDAR),

- ou de sources numériques (API, bases de données, documents, messages, pages web).

Ces données sont souvent normalisées ou pré‑traitées (ex : filtrage du bruit, extraction de texte) afin d’être exploitables.

Moteur de décision : analyser et planifier

C’est le « cerveau » de l’agent. Il peut prendre différentes formes :

- règles simples (si → alors),

- modèles statistiques ou heuristiques,

- modèles IA avancés, notamment les LLM (modèles de langage) capables de raisonner, planifier et appeler des outils.

Des approches comme ReAct (Reason + Act) permettent à l’agent d’alterner réflexion et exécution. D’autres architectures, comme BDI (Belief‑Desire‑Intention), organisent la prise de décision autour des objectifs et de l’état du monde.

Effecteurs : agir sur le monde

Une fois la décision prise, l’agent exécute une action. Celle‑ci peut être :

- physique (déplacer un robot, ouvrir une porte),

- ou numérique (envoyer un message, modifier une base de données, appeler une API).

Mémoire et apprentissage de l’agent IA

L’agent peut conserver : une mémoire court terme (contexte immédiat), une mémoire long terme (préférences, historiques, résultats passés), une base de connaissances (structurée ou via embeddings vectoriels). Cela lui permet d’adapter ses actions au fil du temps.

Par ailleurs, il peut s’améliorer et apprendre grâce à plusieurs mécanismes, comme l’apprentissage supervisé (corrigé par des exemples), l’apprentissage par renforcement (récompenses/pénalités), ou l’apprentissage en continu, basé sur l’expérience.

Nouveaux protocoles d’interopérabilité : MCP & A2A

Deux évolutions récentes permettent aux agents de coopérer plus facilement avec des services externes et entre eux :

- MCP (Model Context Protocol) : permet à un agent IA d’accéder à des outils, bases de données, applications internes ou API de manière standardisée.

- A2A (Agent‑to‑Agent Protocol) : permet à plusieurs agents de communiquer et collaborer entre organisations, logiciels ou plateformes.

Frameworks et plateformes pour développer et orchestrer des agents IA

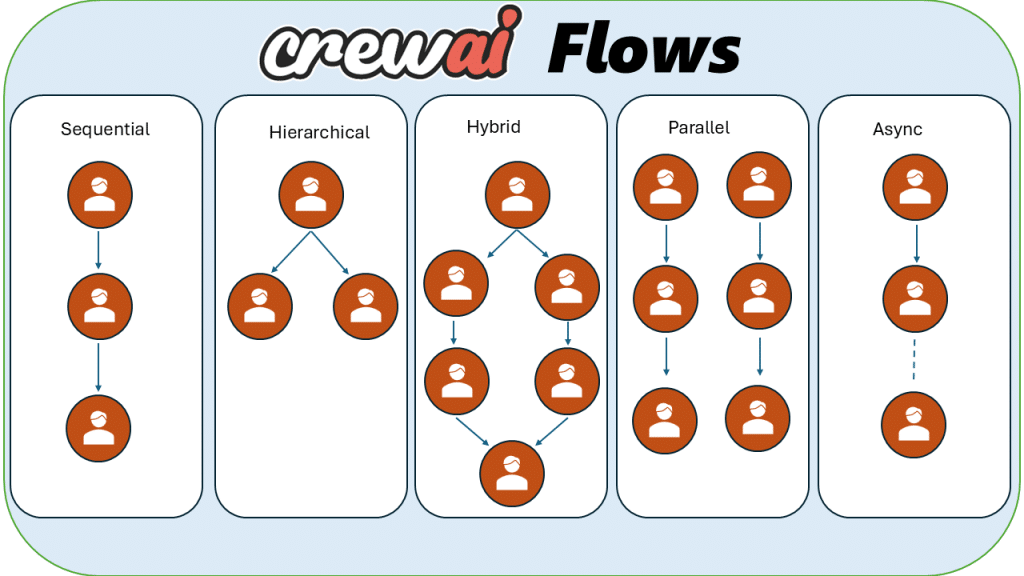

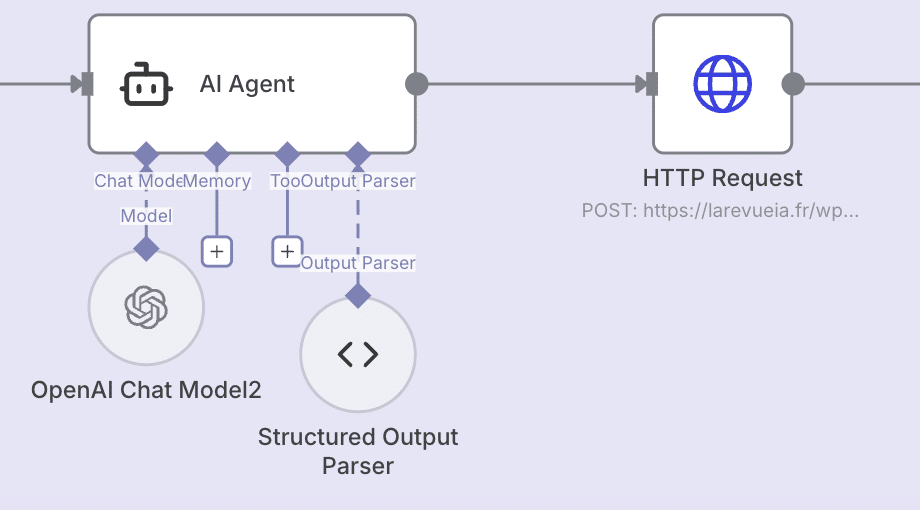

Plusieurs outils facilitent aujourd’hui la création, la coordination et le déploiement d’agents IA :

- LangChain : framework pour connecter un agent IA à des outils, données et chaînes de raisonnement.

- CrewAI : permet de faire collaborer plusieurs agents ayant des rôles différents.

- n8n : plateforme d’automatisation visuelle, utile pour créer des workflows où l’agent interagit avec d’autres systèmes.

Ces frameworks constituent une boîte à outils pratique pour structurer des agents capables d’agir dans des environnements réels.

Éthique, sécurité & gouvernance des agents IA

Le déploiement d’agents IA ne se limite pas aux aspects techniques. Pour passer du POC à la production, il est essentiel d’aborder trois enjeux clés : la sécurité, la gouvernance et surtout la scalabilité.

Aujourd’hui, beaucoup d’entreprises expérimentent des agents IA… mais très peu parviennent à les industrialiser. L’une des raisons majeures est le manque d’observabilité.

L’importance de l’observabilité pour la fiabilité

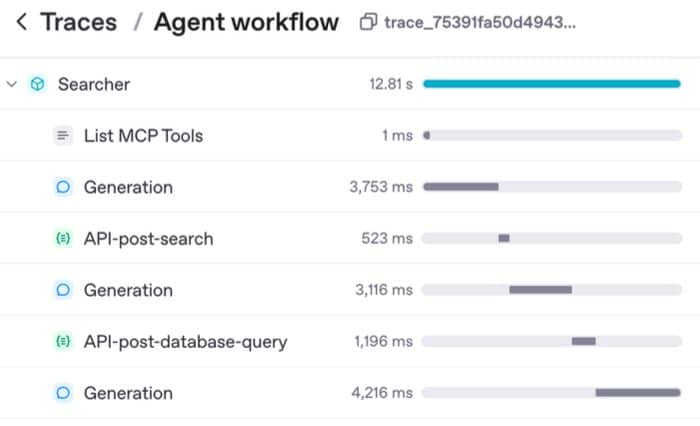

Lorsqu’un agent commence à orchestrer plusieurs LLM, API et outils, son comportement devient difficile à suivre. Avec des architectures multi‑agents, cette complexité augmente encore : le résultat peut changer d’un run à l’autre, sans explication apparente.

Sans observabilité, il est impossible de comprendre ce que l’agent a fait, d’identifier pourquoi un comportement a changé, de reproduire ou corriger un résultat.

C’est là que des outils comme LangSmith ou MLflow deviennent essentiels. Ils permettent de suivre les prompts, réponses, appels d’outils, coûts, latence et erreurs, ce qui facilite l’évaluation et l’amélioration continue.

Transparence & traçabilité

La transparence est essentielle pour comprendre comment un agent IA prend ses décisions. LangSmith, souvent utilisé avec LangChain, permet de tracer chaque étape d’exécution : les prompts envoyés, les réponses obtenues, les appels d’outils et les retours utilisateurs. Cela facilite l’itération et l’amélioration continue.

De son côté, MLflow GenAI apporte le suivi des versions de prompts, la comparaison des résultats et la supervision des performances, dans une interface claire.

Grâce à ces outils, il devient possible de mesurer les coûts et la rapidité d’exécution des pipelines, de gérer le versioning des prompts et des politiques d’agents, et de comprendre précisément quels outils ou actions ont été déclenchés au cours d’un run. Cette visibilité rend l’agent plus fiable, reproductible et modifiable.

Sécurité, alignement et contrôle

Pour éviter les comportements indésirables, il est nécessaire de fixer des limites claires aux agents IA. Cela peut passer par la définition d’une liste d’actions autorisées, l’utilisation d’environnements de test (ou sandbox) avant toute mise en production, et l’intégration d’un mécanisme d’arrêt d’urgence en cas de dérive.

Certaines décisions sensibles doivent également rester sous supervision humaine (human in the loop), afin de garantir l’alignement entre les objectifs de l’agent et les intentions organisationnelles.

Protection des données et conformité

La protection des données est au cœur des déploiements d’agents IA, en particulier lorsqu’ils manipulent des informations personnelles ou confidentielles.

Il convient de limiter la quantité de données collectées, de chiffrer les informations sensibles lorsqu’elles transitent ou sont stockées, et d’assurer la traçabilité des opérations menées par l’agent.

Le respect du RGPD et des politiques internes de gouvernance des données doit être garanti dès la conception.

Conduite du changement : un facteur décisif

L’introduction d’un agent IA transforme les pratiques professionnelles. Pour garantir son adoption, il est important d’impliquer les utilisateurs finaux dès les premières phases du projet, de les accompagner dans l’apprentissage des nouveaux usages et de reconnaître les nouveaux rôles créés, comme celui de superviseur d’agents.

La confiance est un élément clé : un agent, même performant, ne sera pas utilisé si les personnes concernées ne se sentent pas en maîtrise de son fonctionnement. Sans adhésion humaine, même l’agent le plus performant restera inutilisé.

Laisser un commentaire