DALL-E est un modèle de deep learning, entraîné par OpenAI, capable de créer une image à partir d’un simple texte. La première version a été présentée en 2021, et il y a quelques semaines OpenAI a présenté DALL-E 2, une version améliorée et encore plus bluffante (ou effrayante ?).

J’explique le fonctionnement de la génération d’images dans cet article et je montrerai quelques superbes exemples (vous n’êtes clairement pas prêts !).

Présentation du modèle DALL-E et quelques exemples

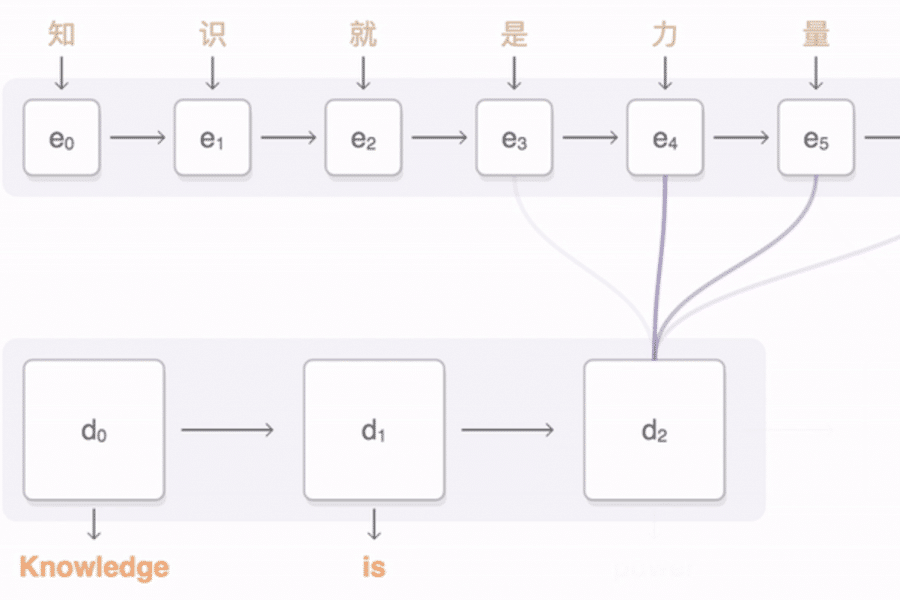

Le modèle Dall-E est une variante de GPT-3, entraînée en utilisant 12 milliards de paramètres, et le dataset d’entraînement comporte 250 millions de paires image/texte (donc n’essayez pas d’entraîner le même modèle chez vous ahah).

Avec ce projet, OpenAI montre encore qu’ils sont devenus la référence en traitement du langage. Cette prouesse a été rendue possible grâce à GPT-3 et à sa capacité à comprendre les phrases avec une grande justesse.

La V1 de Dall-E était déjà impressionnante, voici quelques exemples :

Vous pouvez trouver d’autres exemples sur le compte instagram de DALL-E 2.

Comment tester Dall-e ?

OpenAi n’a pas encore proposé d’essayer le modèle publiquement. Il faut faire une demande, et attendre (longtemps!).

En attendant, HuggingFace a proposé une version Dall-e mini qui permet de faire la même chose, avec une moins bonne qualité (et quelques minutes de votre temps), mais c’est toujours bluffant 🙂

Comme vous le voyez, la version mini n’est pas encore au point ahah.

Quelles sont les applications ?

Les applications de ce projet sont infinies, elles vont de la simple création de contenus artistiques, au e-commerce.

Générer des images pour des articles

Une des applications serait d’utiliser ce modèle pour illustrer ses articles ou ses rapports. Rien que pour La revue IA je passe beaucoup de temps à essayer de chercher des images libres de droits qui décrivent exactement ce que je veux. Je pourrais simplement demander à DALL-E et j’aurais mon image en quelques secondes.

Cette application pourrait soulever de nombreuses questions d’ordre éthique, notamment par rapport aux fake news. J’aborde la question dans la dernière partie de cet article.

Trouver des idées pour la mode ou le design

DALL-E est très fort lorsqu’il s’agit de mixer plusieurs objets ou concepts, comme l’avocat et le fauteuil (cf. partie 1). Cette créativité pourrait être réutilisée par des créateurs de mode ou des designers pour concevoir de nouvelles pièces.

Voici ce que ça pourrait donner :

J’adore cette veste !

DALL-E 2 pour le e-commerce

DALL-E 2 est capable de modifier une image rapidement, ainsi, pour la mode, on pourrait générer une photo de mannequin et lui faire porter différentes pièces.

Pour d’autres objets, on peut générer des situations dans lesquelles ces objets pourraient être utilisés sans avoir à les reproduire.

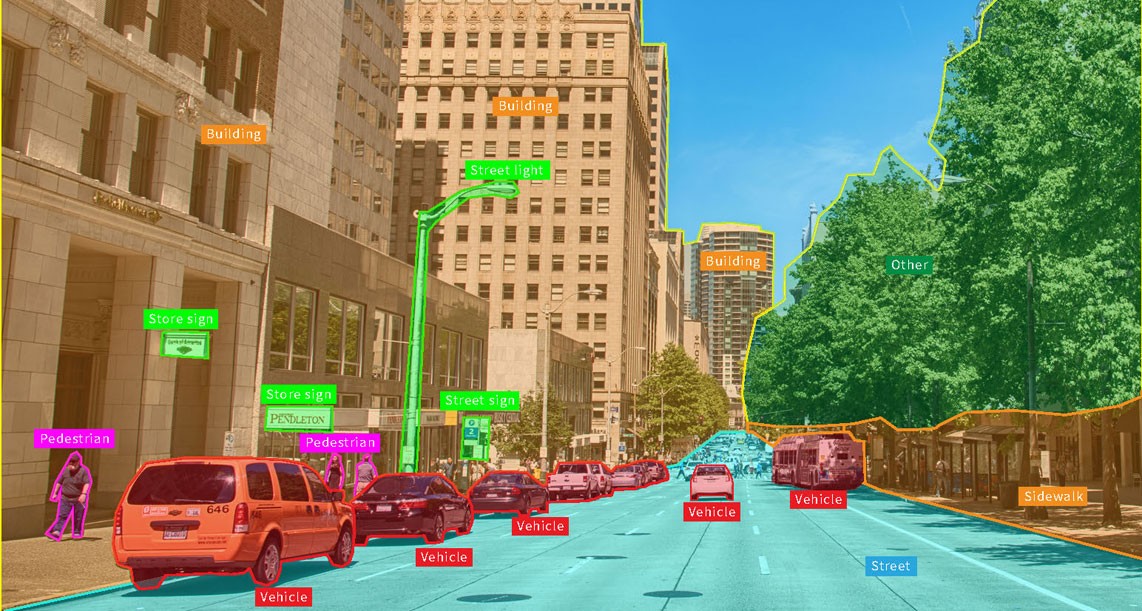

Vérifier la robustesse d’un modèle de NLP

Par ailleurs, une application intéressante de DALL-E (ou des autres modèles de génération d’images à partir de textes) est que l’on peut les utiliser pour vérifier qu’un modèle de NLP comprend bien la phrase qu’on lui donne.

Cela permettrait d’éviter de grosses confusions. Dans le médical par exemple, on pourrait s’assurer que la compréhension d’un modèle de traduction est bonne en lui faisant générer une image. Plutôt que de simplement fournir la traduction de « j’ai mal au dos », le modèle générera une image pour prouver qu’il a compris.

Les limites de DALL-E et l’aspect éthique

DALL-E est fort ! Très fort ! Et de grands pouvoirs impliquent de grandes responsabilités.

J’en parlais un peu plus haut, la menace principale est la possibilité d’alimenter les fake news. On peut générer de façon réaliste n’importe quelle situation, cela pourrait donner des idées à des personnes mal-intentionnées…

Par ailleurs, ces modèles pourraient mettre beaucoup de monde au chômage. Je dis souvent que le danger premier des IA n’est pas le fait qu’elles vont remplacer l’humain, mais dans ce cas précis, je pense que c’est différent, l’inquiétude est réelle. En tout cas le business model et les moyens de rémunérations des photographes/artistes devront être repensés.

Ces limites éthiques ont poussé OpenAI à limiter l’accès à DALL-E. Seuls quelques privilégiés auront le droit de le tester (j’ai envoyé ma demande, j’espère en faire partie !). OpenAI a aussi mis en place des systèmes de modérations de l’utilisation du modèle, pour éviter la génération de contenus pornographiques, offensants ou à caractères religieux et politique.

Enfin, la robustesse de ces modèles repose en grande partie sur la taille du dataset d’entraînement utilisé et le nombre de paramètres du réseaux de neurones. Ce qui d’une part pose des problèmes pour l’environnement, et d’autres part met en exergue le contrôle total et le monopole exercé par des entreprises ou des organisations comme Google ou OpenAI.

Jamais une petite entreprise n’aurait été capable de concevoir un modèle aussi robuste, personne en dehors d’une poignée d’acteurs n’a les moyens pour le faire.

Je vous laisse d’autres exemples pour la route 🙂

Laisser un commentaire