Du fait de ses enjeux économiques et sociaux, l’intelligence artificielle inonde le débat public. Elle risque même de devenir omniprésente dans nos vies futurs Tant les progrès enregistrés sont fulgurant. Il reste cependant un point noir à éclaircir. Quel droit pour l’intelligence artificielle ? Quand bien même elle ne prend pas vie (nous sommes loin des Ex-Machina et autres robots de Westworld), l’intelligence artificielle sera amenée dans le futur à prendre part à des taches où sa responsabilité sera mise en jeu. Mais qui peut-on tenir responsable en cas de défaillance ou de raté grave qui pourrait impliquer la vie d’êtres vivants ? Le concepteur de l’intelligence artificielle ? L’intelligence artificielle elle-même ? Nous allons voir à travers deux exemples qu’il n’est pas aisé de répondre à cette question.

Enjeux juridiques de l’automatisation de nos modes de transports actuels

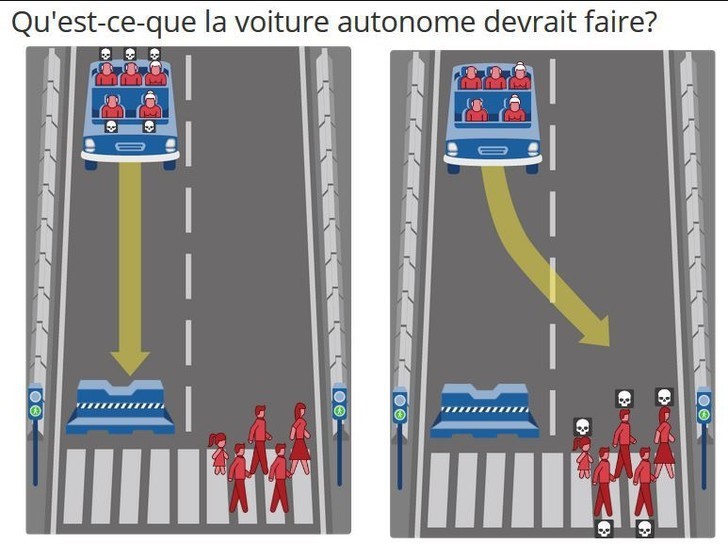

Dans un futur pas très lointain, les voitures autonomes inonderont le parc automobile français et mondial. Dès lors, des questions éthiques fondamentales se posent. Tout d’abord, il y a le dilemme classique de « qui doit-on sacrifier ». Le dilemme ce présente comme suit : en cas d’accident, si l’IA de la voiture autonome doit écraser une groupe de piétons et en épargner un autre, qui doit-elle choisir ?

On peut appliquer ce dilemme à plusieurs groupes différents : homme vs femme, personne âgée vs personne jeune, occupant du véhicule vs piétons, humains vs animaux. Pour remédier à ce problème, une équipe de chercheur a tenté de trouver une réponse en sondant des internautes du monde entier. Outre l’aspect contestable, la méthode pose problème puisque les réponses varient énormément entre les pays, les cultures et même entre les personnes.

On retrouve aussi des réponses très surprenantes et discutables… Ainsi, certains internautes préfèrent sauver un chien plutôt qu’un individu qui ne respecte pas le code de la route…

Une seconde question se pose, à qui revient la faute en cas d’accident ? Lorsqu’un accident à lieu, qui doit-on tenir pour responsable ? Le constructeur du véhicule autonome puisque c’est lui qui a décidé qui devait être sacrifié ? L’IA elle-même, et donc une émergence de la justice de l’IA bien que cette dernière ne soit pas consciente ? Le conducteur, pour ne pas avoir réagit et essayer de prendre le contrôle du véhicule ?

De plus, les scénarios pris en compte dans leur expérience sont trop simplistes. Les variables qui entrent en jeu sont trop nombreuses ; tout dépend de la situation et des comportements imprévisibles des parties qui entrent en jeu. Par exemple, la majorité d’entre nous serait d’accord pour sacrifier l’occupant du véhicule afin de sauver 10 piétons n’est-ce pas ? Mais sachant cela, seriez-vous toujours prêt à acheter une voiture autonome ? Heureusement que ces questions ne seront posées seulement pour une quantité infime de cas. Nul doute que globalement les voitures autonomes seront plus surs pour tout le monde.

Un autre problème se pose également : doit-on accorder le monopole à l’entreprise qui conçoit les véhicules autonomes les plus sûrs ? La question se pose puisque si on ne le fait pas, certaines parties de la population se trouveraient avec des véhicules moins sécurisés. Et comment jugeraient-on la sécurité d’un véhicule autonome ? Tant de questions restent pour le moment en suspens, mais il faudra leur apporter des réponses le moment venu.

Responsabilité des IA en médecine

En médecine, les IA seront amenées à manipuler des données sensibles impliquant l’intégrité physique ou morale des personnes. Il est donc nécessaire de concevoir des IA fiables qui donneront des résultats utilisables. Cela étant dit, nous ne sommes jamais à l’abris d’une erreur, d’un bug du système ou d’un défaut de conception qui pourrait avoir de grave conséquences.

La mathématicienne Cathy O’Neil va jusqu’à évoquer la nécessité d’un « Serment d’Hippocrate » pour la data science.

Beaucoup d’espoirs sont fondés sur l’intelligence artificielle en matière de santé. Elle permet par exemple de faire des diagnostics plus précis et plus rapides, libérant ainsi du temps au personnel médical et aux médecins pour effectuer des taches plus complexes. L’IA en médecine s’appuie sur 2 approches : l’approche symbolique (fondée sur la logique) et l’approche numérique (fondée sur les données).

L’approche symbolique est celle qui est utilisée dans l’aide à la décision en médecine, elle commence peu à peu à être utilisée. Cependant, le risque majeur en matière de santé est la perte de libre arbitre du système soignant. Si l’analyse de l’IA se révèle erroné ou biaisé, elle peut prendre une décision qui n’est pas adaptée au patient, voire mettre sa vie en danger.

En effet il ne s’agit plus ici d’objets sans vie que l’intelligence artificielle à l’habitude de traiter, mais bel et bien de réel êtres humains. Là où l’IA pouvait « se permettre » de faire quelques ratés, l’erreur n’est ici plus permise. Les médecins doivent donc avoir une idée de la façon dont l’algorithme fonctionne, pour qu’il puisse toujours garde la main mise sur l’IA et peuvent juger si le jugement de l’IA est correcte. Sans parler de l’importance du relationnelle dans la médecine : une machine n’est pas capable d’empathie.

En assurance on distingue l’assurance vie (impliquant des personnes) et l’assurance non-vie (impliquant des objets), ne serait-il pas envisageable de faire de même en data science ?

L’approche numérique recherche des ressemblances dans les données disponibles afin d’en dégager des connaissances. La plupart des systèmes actuels procèdent par apprentissage non supervisé (pour ceux qui ne savent pas ce que c’est, nous avons fait un super article là-dessus 😉) en utilisant des réseaux de neurones (pour ceux qui ne savent pas ce que c’est vous savez où aller 😉).

Cette méthode est utilisée par exemple pour détecter si une personne a des signes pathologiques en vérifiant si l’image présente une anomalie ou non. Néanmoins, un problème se pose quant aux données. Elles doivent nécessairement provenir d’autres patients, mais accepteront-ils de les donner ? Peut-on les forcer à les donner sous prétexte de faire avancer la médecine ? Quid de la sécurité des données (même s’ils sont a priori anonymisées) ?

Tant de questions qui restent en suspens pour le moment.

On retrouve également ici le problème classique : qui faut-il blâmer en cas de problème ? L’IA, le constructeur ou bien le médecin en charge du patient et de celle-ci ?

Les deux exemples que nous avons passés en revue montrent les difficultés auxquelles nous sommes confrontés lorsqu’il s’agit d’éthique concernant l’IA. Cependant les avancées en matière d’éthique des IA commencent à se faire. Plusieurs pays ainsi que plusieurs firmes commencent à se positionner sur le sujet, à se poser les bonnes questions et commencent à y réfléchir. Vous pouvez évidemment contribuer au débat en nous donnant votre avis !

Leave a Comment